| URL: | http://netzspannung.org/database/100173/de |

| Last update: | 01.07.2003 |

| Date of print: |

|

CAVE und Tangible User Interface |

Kurzdarstellung

Kurzbeschreibung

Das Mixed Reality Tanztheater verknüpft Realwelt und virtuelle Welt. In dem realen Bühnen- und Zuschauerraum tragen die ZuschauerInnen Augmented Reality Interfaces, mittels derer sie parallele Erzählschichten in einem, von ihnen gewählten, zeitlich-räumlichen Kontext erleben. Sie führen in einer aktiven Rolle - unabhängig von ihrem physischen Aufenthaltsort - die Regie für ihre individuelle Wahrnehmung der Veranstaltung.

Neue Technologien aus dem Bereich der Kommunikations- und Visualisierungstechnik ermöglichen eine expressive, non-lineare Erzählweise.

In einer vernetzten Installation aus CAVE und Augmented Reality (AR) wird das Szenario für eine zukünftige Tanztheatervorstellung immersiv erlebbar.

Reiz und Motivation dieser Arbeit liegen im Zusammenspiel von Schein und Wirklichkeit, virtuellem und realem Raum.

KünstlerInnen / AutorInnen

- Manja Kurzak

Entstehung

Deutschland, 2002-2003

Partner / Sponsoren

technische Unterstützung: Uwe Wössner (Höchstleistungsrechenzentrum Universität Stuttgart)

Eingabe des Beitrags

Manja Kurzak, 01.07.2003

Kategorie

- Bildung und Lernen

Schlagworte

- Themen:

- Repräsentation |

- Wearable Computing |

- Theater |

- Konzeptuelle Arbeit |

- Mixed Reality |

- Raum |

- Tanz |

- Telepräsenz |

- Architektur

- Formate:

- Virtuelles Environment |

- 3D |

- interaktiv |

- multi-user |

- Computeranimation |

- vernetzt

- Technik:

- CAVE |

- VRML

Inhalt

Inhaltliche Beschreibung

Das "Mixed Reality Tanztheater" nutzt Einsatzmöglichkeiten der zukunftsweisenden Forschungsgebiete virtueller, überlagerter und gemischter Realität (Virtual Reality VR, Augmented Reality AR, Mixed Reality MR) jenseits rein funktionaler Anwendungen. In einem künstlerischen Kontext spielt die Arbeit mit dem Aufeinandertreffen von virtuellen und realen Inhalten.

Konzept:

In einem experimentellen Tanztheaterstück sehen und erleben die ZuschauerInnen eine Collage aus realen und virtuellen Darstellungen. Statt dem klassischen Opernglas erhalten sie Augmented Reality Interfaces als erweiterte Sehhilfen. Unabhängig von ihrem physischen Standort können sie ihren Blickpunkt im realen und virtuellen Raum verlagern. Im Vergleich zu konventionellen Vorstellungen mit fester Bestuhlung und vorgegebener Blickrichtung auf den Bühnenraum eröffnen sich dem Publikum neue, selbst gewählte Perspektiven.

Bei dem Stück handelt es sich um eine Veranstaltung, die an zwei realen, räumlich voneinander entfernten Orten zeitgleich stattfindet. An jedem der beiden Orte befindet sich jeweils ein realer Tänzer und eine virtuelle Repräsentation, sprich Avatar, des jeweils anderen Tänzers. Bewegung wird mit dem so genannten MotionCapture Verfahren digitalisiert und graphisch verändert in den Displays der Teilnehmer des anderen Schauplatzes wiedergegeben.

Tanz, sprich körperliche Bewegung im Raum, bildet das Kommunikationsmittel der Akteure. Neben der Ausdruckskraft der Bewegung dient die, sich im Laufe der Veranstaltung verändernde, visuelle Gestaltung der Avatare als eine zusätzliche Nuance der Kommunikation.

Inhaltliche Umsetzung:

Auf der Seite des Zuschauers wird vor allem das Loslösen aus einer passiven Betrachtungsweise aufgezeigt. Die Verwendung von AR Displays, mobilen Eingabegeräten und Position Tracking erlauben ihm eine freie Standortwahl im Raum. Neben der Freiheit sich im Raum zu bewegen, kann er seinen virtuellen Blickpunkt im Raum verlagern. Auf diese Weise erschließen sich ihm assoziative Erzählschichten in seinem individuellen Blickfeld.

Auf der Seite der Tänzer / Akteure liegt der Schwerpunkt der Arbeit in der Gestaltfindung und visuellen Umsetzung der virtuellen Repräsentationen (Avatare) der Tanzenden.

Visuelle Umsetzung:

Die optische Gestaltung der Tänzeravatare ist aus unterschiedlichen Gedankenmodellen der gegenseitigen Körper- und Raumwahrnehmung aus der Tanztheorie hergeleitet. Um den Umfang dieses Textes zu begrenzen, möchte ich hier nur beispielhaft einige Tanztheoretiker und Choreographen namentlich erwähnen: Oskar Schlemmer (1888-1943), Rudolf von Laban (1879-1958) und Merce Cunningham (1912).

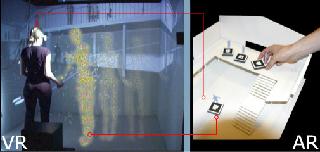

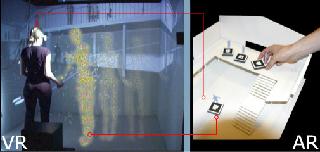

Das Nebeneinander von realen Inhalten und Körpern und virtuellen Repräsentationen wurde in einer Verknüpfung aus CAVE (dreidimensionaler, interaktiver Wahrnehmungsraum, Maßstab 1:1) und einer Augmented Reality Anwendung an einem physischen Architekturmodell (überlagerte Realität, Maßstab 1:33,3) präsentiert.

Annäherung und Distanzierung zwischen dem Teilnehmer in der CAVE und dem über eine tangible Eingabefigur agierenden Teilnehmer am physischen Modell lösen Veränderungen im Klang- und Bewegungsraum aus.

Den real-räumlichen Kontext bildet das Gebäude des Forum Neues

Musiktheater, ein Projekt der Oper Stuttgart (http://www.staatstheater.stuttgart.de). Das Gebäude wurde in 3d visualisiert, sowie als physisches Architekturmodell gebaut.

Hintergrund:

Definition Tanztheater:

Tanztheater ist eine Weiterentwicklung des Ausdruckstanzes und charakterisiert sich durch die Darstellung von Alltagssituationen, Emotionen und menschlichen Ängsten.

Die non-lineare Erzählweise, meist ohne eine durchgängige Handlung, arbeitet mit der Collage verschiedener Ausdrucksformen und Medien.

Neue Technologien:

Neue Werkzeuge werden in dieser Arbeit im Sinne von Marshall McLuhan* als Erweiterung des menschlichen Körperraumes und der menschlichen Funktionen aufgefasst.

(* 1911-1980, kanadischer Medienforscher)

Technik

Technische Beschreibung

Die dreidimensionale Umgebung sowie Körper und Animationen wurden mit 3d Studio Max erstellt. Animationsgrundlage für körperliche Bewegung lieferten aus mehreren Perspektiven filmerisch dokumentierte Tanzsequenzen. In die Szenen montiertes Filmmaterial (Movie Mappings) von realen Tänzern dient der Verdeutlichung des Zusammenspiels von realen und virtuellen Inhalten. Aus 3d Studio Max wurde das Material unter Verwendung eines speziellen COVER Plugins als VRML 97 exportiert und mit dem Programm VrmlPad editiert. Weitere Funktionen sowie komplexere Interaktivität wurden als JavaScript, bzw. in C++, ergänzt. Die VRML Dateien wurden mit der Software COVER für die Wiedergabe in der 4-Seiten-CAVE des HLRS Universität Stuttgart und der Video-getrackten AR Anwendung (ARToolKit) verarbeitet.

CAVE und AR Anwendung bilden eine kollaborative Einheit, d.h. Interaktionen sind in Echtzeit in beiden Umgebungen sichtbar. In der CAVE erfolgen Eingaben über Standpunkt, Blickpunkt, variable Distanzen und eine 3D Mouse. Die Umgebung hat den Maßstab 1:1. Bei der AR Anwendung bilden von Hand bewegbare Figuren (Tänzer und Zuschauer) ein Tangible User Interface. Besonders hierbei ist die Unmittelbarkeit räumlicher Eingaben durch den Benutzer im Gegensatz zu zweidimensionalen graphischen Benutzeroberflächen gegeben. Den räumlichen Kontext stellt ein physisches Gebäudemodell im Maßstab 1:33,3. Die mit der virtuellen Umgebung überlagerten Videoaufnahmen wurden nahe dem Modell auf eine Leinwand projiziert.

Sowohl in der CAVE als auch in der AR Anwendung sieht man animierte Tänzer-Avatare, die die Position und Interaktion des jeweils anderen Benutzers repräsentieren. Neben räumlicher Bewegung können durch Tastatureingabe Blickpunkte einzelner Figuren eingenommen werden. Tastatureingaben lösen des Weiteren Animationen, wie beispielsweise den Applaus eines Zuschauers, aus. Entscheidend für die Wahl einer auf zwei Orte verteilten Mixed Reality Präsentation ist die Tatsache, dass es sich ebenfalls im gezeigten Szenario um eine Konstellation mit gemischter Realität und Telepräsenz handelt.

Der Film mr_tanztheater.wmv zeigt Videoaufnahmen aus CAVE und AR Anwendung. Natürlich kann die dreidimensionale Darstellung in der CAVE und das plastische Eintauchen in die virtuelle Umgebung nur ansatzweise durch diese Aufnahmen vermittelt werden.

Hardware / Software

Datenerstellung auf handelsüblichem PC

Software: 3d Studio Max, Adobe Tools

Cave Anwendung:

Software: COVER (siehe:http://www.hlrs.de/organization/vis/covise/features/cover/)

Hardware: CUBE (CAVE), Projektoren, Shutterglass-Brillen, Kopf- und Handpositiontracking (genaue Spezifikationen siehe: http://www.hlrs.de/organization/vis/velab/)

AR Anwendung:

Software: COVISE (siehe: http://www.hlrs.de/organization/vis/covise/), ARToolKit

Hardware: digitale Videocamera, Notebook, physisches Architekturmodell, Figuren mit Markern

Kontext

Hochschule / Fachbereich

Universität Stuttgart

Architektur und Stadtplanung

URL der Hochschule

» http://www.architekt…tur.uni-stuttgart.de/

Betreuer des Projekts

Prof. Joachim Kieferle

Kommentar des Betreuers

Mit der Diplomarbeit "Mixed Reality Tanztheater" hat Frau Kurzak technisches und gestalterisches Neuland betreten und eine herausragende Arbeit präsentiert. Es ist ein Projekt jenseits klassischer Architektur mit klaren Wurzeln in der Architektur. Begriffe wie beispielsweise Raum, Raumwahrnehmung oder Raumkomposition werden neu interpretiert und mit den Möglichkeiten von Augmented Reality und Virtual Reality erweitert bzw. angepasst.

Durch eine breit gefächerte Recherche in den Bereichen Informationsvisualisierung, Wahrnehmungstheorie und neue Technologien hat Frau Kurzak ein solides Fundament für ihr technisch-gestalterisches Konzept geschaffen. Inhaltlich hat sie mit Untersuchungen von geschichtlichen bis aktuellen Referenzprojekten aus den Bereichen Tanz und Theater eine wichtige und sehr solide Basis erarbeitet.

Mit den komplexen, sich teilweise sogar widersprechenden Inhalten ist Frau Kurzak experimentell und trotzdem sehr souverän umgegangen und hat eine konsequente, schlüssige Lösung erarbeitet.

Seminar / Kurzbeschreibung

Das Mixed Reality Tanztheater ist im Rahmen der sechsmonatigen Diplomarbeit am Institut für Grundlagen der Planung (IGP) entstanden.

Das Thema der Arbeit wurde von Frau Kurzak frei gewählt und bearbeitet. Dabei wurde sie technisch vom Rechenzentrum der Universität Stuttgart / Höchstleistungsrechenzentrum unterstützt.

Zuordnung Forschungsbereich

Institut für Grundlagen der Planung (IGP) an der Fakultät für Architektur und Stadtplanung, Universität Stuttgart.

|

|

| » http://www.mixedreal…ty-tanztheater.de.vu/ |

|

|